API+AI 融合网关

一体化 API 网关与 AI 网关集成平台

为什么选择 aiway ?

基于 Rust 构建,高性能

采用 Rust 语言开发,提供卓越的性能表现和内存安全性,确保系统在高并发场景下依然稳定可靠。

可视化路由配置

直观友好的可视化界面,让您轻松配置和管理 API 路由,无需编写复杂配置文件,提升运维效率。

服务负载均衡

内置智能负载均衡算法,支持多种调度策略,自动分发请求到后端服务,保障系统高可用性。

AI 集成(模型路由、MCP 集成)

深度集成 AI 服务能力,支持智能模型路由、MCP(Model Context Protocol)协议,轻松构建 AI 原生应用。

统一 API Key 管理

集中化的 API Key 管理体系,支持权限控制、使用统计和安全审计,让 API 访问更安全可控。

高性能插件系统

灵活可扩展的插件架构,支持自定义插件开发,满足多样化业务需求,打造专属功能生态。

核心功能展示

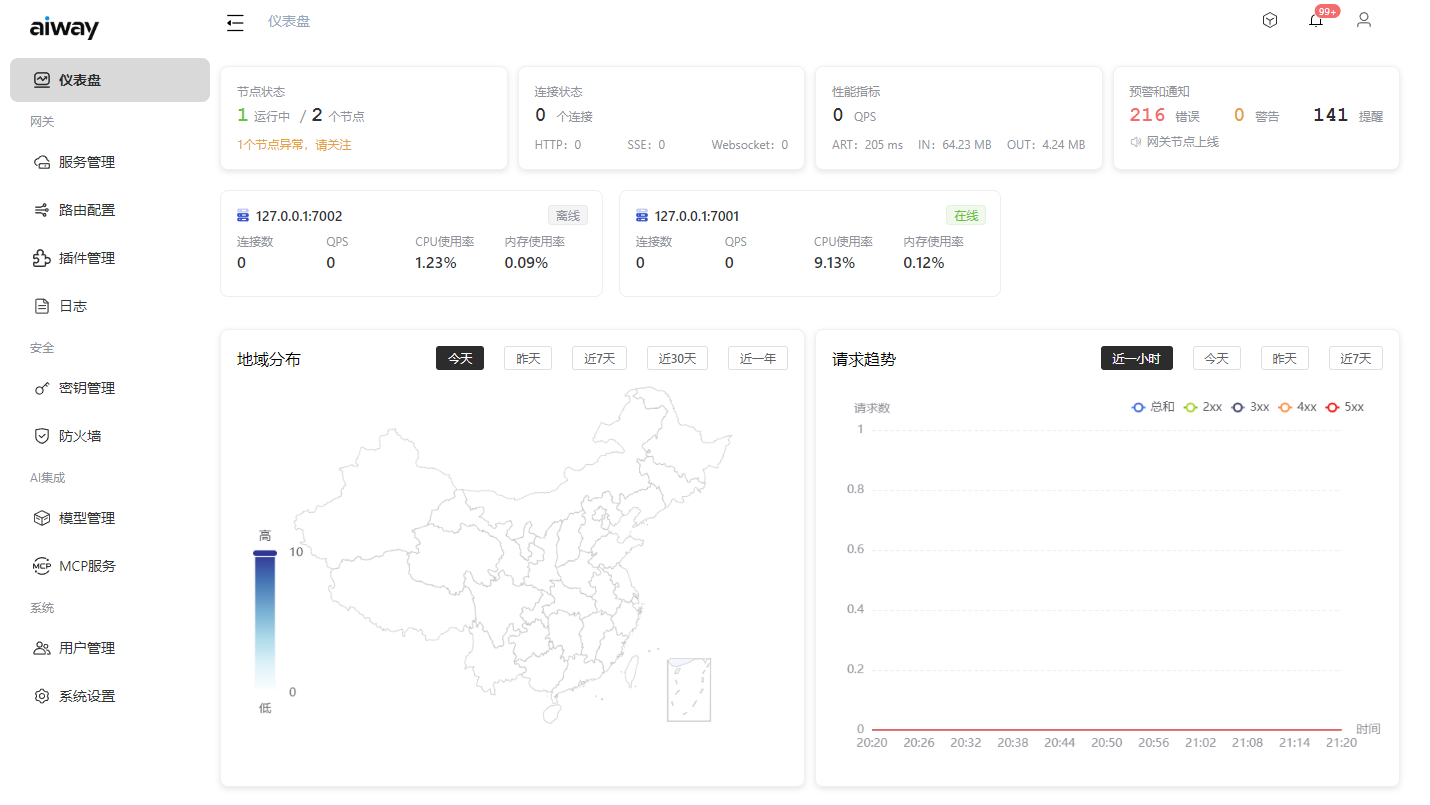

可视化仪表盘

全局掌控网关运行状态,实时监控节点健康度、性能指标和流量分布。直观的图表展示让您对系统运行状况一目了然。

- 节点状态实时监控,支持多节点管理

- 性能指标可视化(QPS、响应时间、流量统计)

- 地域分布热力图,洞察请求来源

- 请求趋势分析,支持多维度时间筛选

- 预警和通知系统,及时发现异常

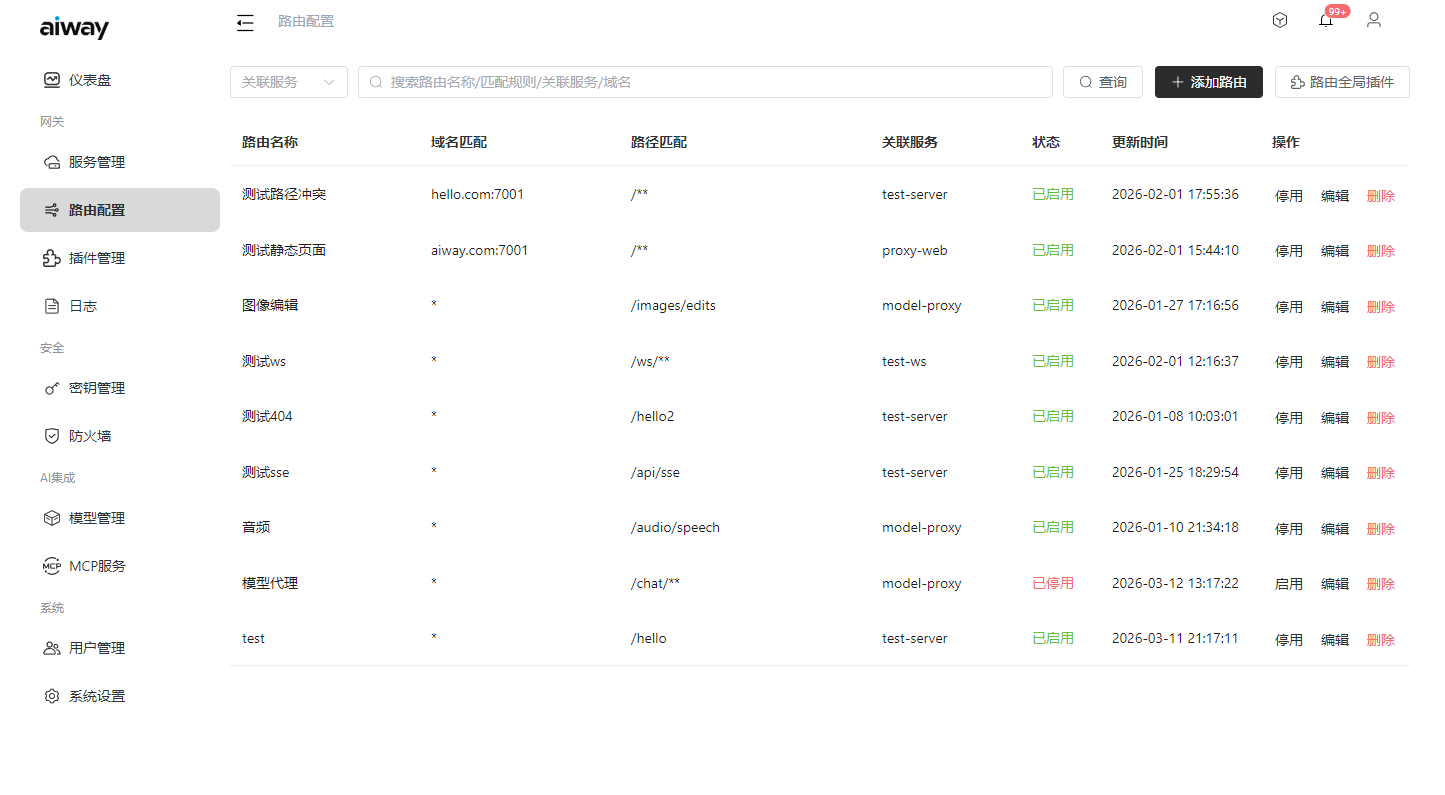

可视化路由配置

简单易用的路由配置界面,支持域名匹配、路径匹配等多种规则。无需编写复杂配置文件,可视化操作即可完成路由管理。

- 支持域名匹配和路径匹配规则

- 路由状态管理(启用/停用)

- 关联服务灵活配置

- 路由规则搜索和过滤

- 支持 HTTP、SSE、WebSocket 等多种协议路由

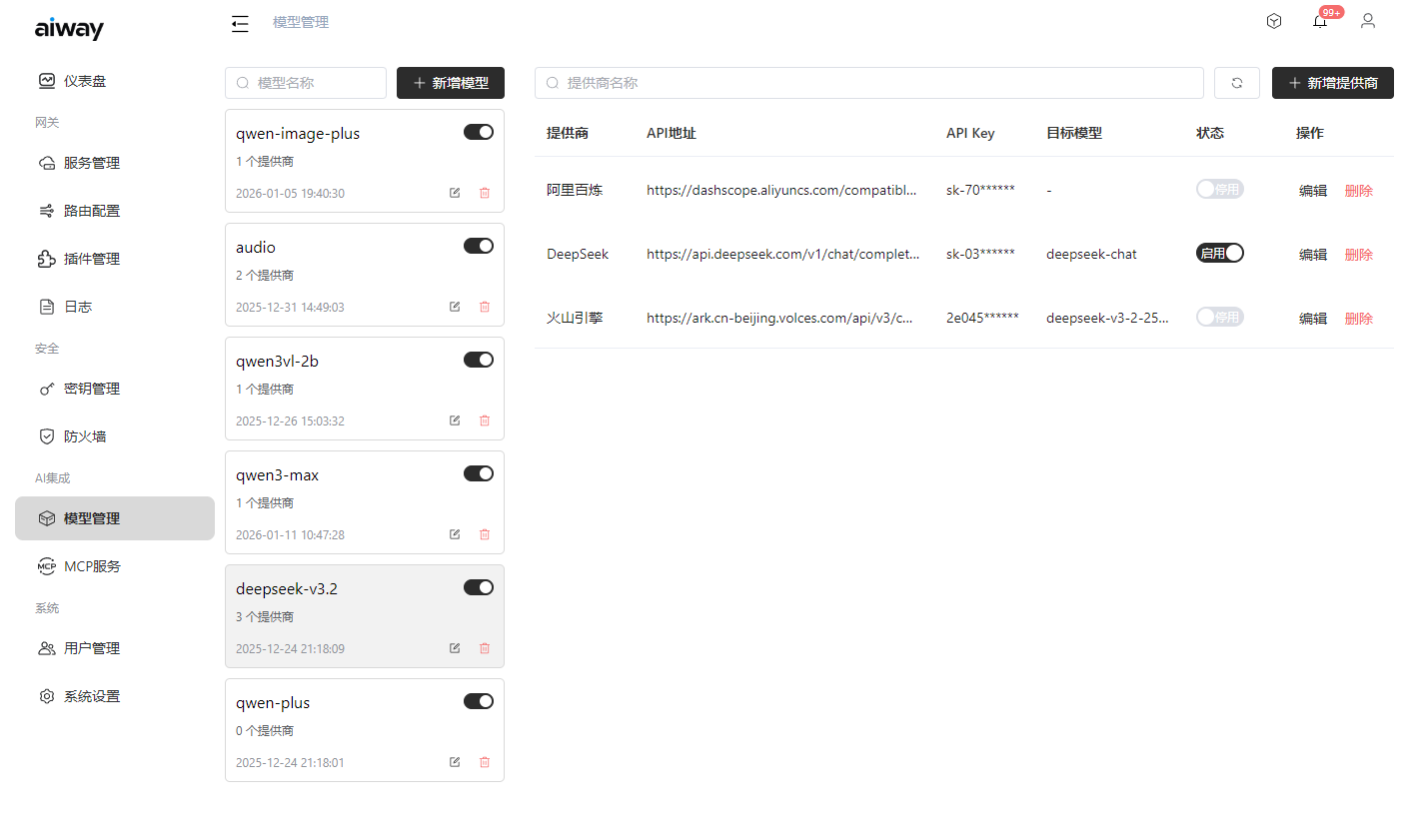

AI 模型统一管理

集中管理各大 AI 服务提供商,统一配置 API Key 和模型参数。支持多模型路由和负载均衡,让 AI 服务调用更简单高效。

- 支持主流 AI 提供商(阿里百炼、DeepSeek、火山引擎等)

- 模型与提供商分离管理

- API Key 安全存储和管理

- 模型状态控制(启用/停用)

- 目标模型灵活配置

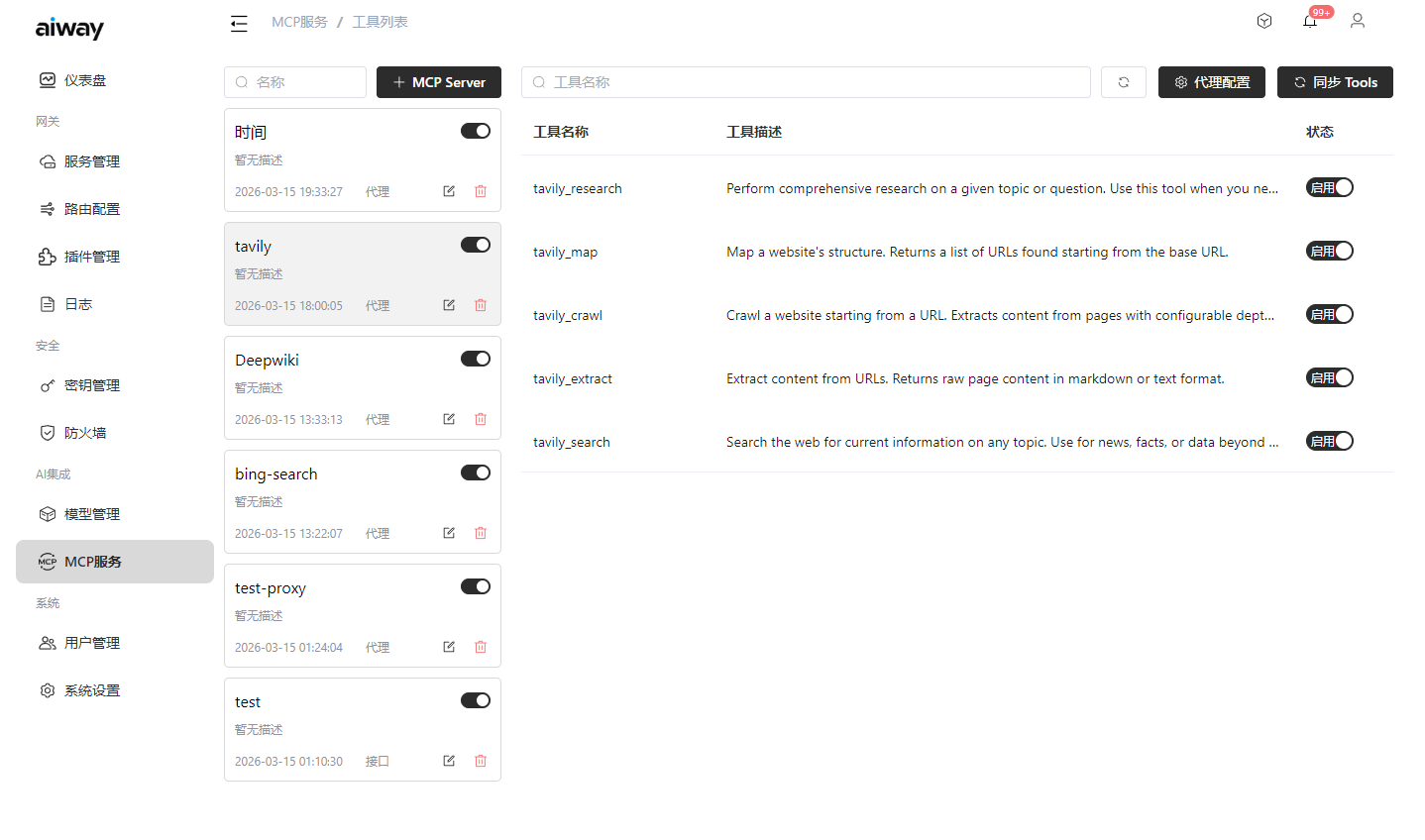

MCP 服务集成

基于 Model Context Protocol (MCP) 协议,轻松集成各类 AI 工具和服务。构建强大的 AI 生态系统,扩展无限可能。

- 支持 MCP Server 快速接入

- 工具列表可视化管理

- 工具描述和状态展示

- 代理配置支持

- Tools 同步功能,保持最新状态

精简架构

轻量级

极小的资源占用,启动后仅占用30M内存,可在廉价服务器上轻松运行,减少硬件成本。

无需第三方依赖

零外部依赖,独立运行,避免复杂的环境配置和潜在的兼容性问题。

去容器化

不依赖 Docker 等容器技术,直接运行在操作系统上,降低运维复杂度。

秒级启动

优化的启动流程,实现秒级快速启动,随时响应业务需求。

水平扩展

支持多节点部署,通过简单的水平扩展应对业务增长,轻松承载更大流量。

降本增效

通过简洁的架构设计,在保持高性能的同时,降低网关的部署和维护成本。

信创支持

适配主流国产操作系统,满足信创要求,助力企业实现信息技术应用创新

统信 UOS

适配统信 UOS 操作系统,提供稳定可靠的运行环境,支持桌面版和服务器版。

麒麟 KylinOS

兼容银河麒麟操作系统,确保在关键领域的自主可控应用。

欧拉 openEuler

原生支持 openEuler 社区发行版,充分发挥开源生态优势,打造高性能基础设施。